DeepSeek

Anthropic звинувачує китайські компанії в масовій крадіжці можливостей Claude

Редактор

Компанія Anthropic звинуватила трьох провідних китайських розробників штучного інтелекту — DeepSeek, Moonshot та MiniMax. Їм закидають використання дистиляції в «промислових масштабах» для незаконного вдосконалення власних моделей на базі відповідей Claude. Загалом зафіксовано 16 мільйонів обмінів даними через мережу з 24 000 шахрайських облікових записів, пише Tom’s Hardware.

Нова LLM-модель Deepseek v3.1 «краща за Claude Opus 4 і в 68 разів дешевша»

Редактор

Китайський стартап DeepSeek без зайвих анонсів випустив абсолютно нову LLM-модель V3.1. Вона має відкритий код, 685 мільярдів параметрів і довжину контексту до 128k, пише Venture Beat.

Китайська влада наполягла, щоб DeepSeek навчала модель R2 на обладнанні Huawei. Але щось пішло не так

Редактор

Провідний китайський стартап у сфері штучного інтелекту DeepSeek був змушений відкласти випуск своєї майбутньої моделі R2 через труднощі з її навчанням. Проблеми почались після втручання політиків у робочі процеси, повідомляє Tom’s Hardware.

Реліз LLM-моделі DeepSeek R2 затримується. Причина в Nvidia

Редактор

Китайська компанія DeepSeek зазнала невдачі в розробці нової LLM-моделі R2, оскільки їй не вдалось отримати достатню кількість графічних процесорів Nvidia. Про це повідомляє Silicon Angle.

Китайська компанія MiniMax стверджує, що її нова модель краща за DeepSeek R1-0528

Редактор

Компанія MiniMax з Шанхаю випустила нову LLM-модель під назвою MiniMax-M1. Вона має відкритий код і, як стверджується, більш ефективна, ніж всі конкуренти, створені в Китаї. Компанія-розробник запевняє, що MiniMax-M1 перевершує останню модель DeepSeek R1-0528 у кількох бенчмарках. Про це повідомляє Bloomberg.

DeepSeek стверджує, що її оновлена модель R1 краще справляється з програмуванням

Редактор

Китайський стартап DeepSeek заявив, що його оновлена LLM-модель R1 може виконувати математичні обчислення, програмування та загальну логіку краще, ніж попередня версія, при цьому менше викликає галюцинації. Про це повідомляє Bloomberg.

Співробітникам Microsoft заборонили використовувати DeepSeek

Редактор

Співробітникам Microsoft заборонено використовувати DeepSeek через проблеми безпеки даних та побоювання китайської пропаганди. Про це на слуханнях в Сенаті США заявив президент Microsoft Бред Сміт, пише TechCrunch.

DeepSeek випускає нову безкоштовну модель V3-0324. Вона краща в програмуванні, ніж GPT-4o

Редактор

Китайська компанія DeepSeek випустила нову велику мовну модель, яка не тільки безкоштовна, але й перевершує Claude Sonnet 3.5. Модель DeepSeek-V3-0324 важить 641 гігабайт, має 685 мільярдів параметрів і доступна для комерційного використання за ліцензією MIT. Ще однією перевагою є те, що вона може працювати безпосередньо на апаратному забезпеченні споживчого класу, зокрема Mac Studio від Apple з чіпом M3 Ultra, пише Venture Beat.

DeepSeek-R1 може створити кейлоггер і генерує код програм-вимагачів — дослідження

Редактор

Флагманська модель R1 від DeepSeek здатна генерувати кейлоггер і базовий код програм-вимагачів. Для цього достатньо кількох підказок, пише The Register.

Формула 1 в галузі ШІ: чи зможе DeepSeek обігнати ChatGPT?

Кінець січня був насичений подіями, які сколихнули світ: інавгурація президента США Дональда Трампа, щорічний Всесвітній економічний форум (ВЕФ) у Давосі та запуск нового конкурента ChatGPT — DeepSeek. Зокрема, останній вже встиг вплинути на фінансові ринки, оскільки акції багатьох компаній впали в ціні на тлі його запуску. Однак чи справді новий чат-бот є революційним і кращим за своїх дорожчих конкурентів — ChatGPT від OpenAI та Gemini від Google? Розглянемо докладніше.

DeepSeek пропонує дешеві нічні тарифи на доступ до моделей V3 або R1

Редактор

Китайська компанія DeepSeek для більш рівномірного навантаження на свою технічну інфраструктуру запроваджує нічний тариф для доступу до моделей V3 або R1. Тепер, якщо користувач хоче зекономити до 75% вартості доступу, він може підключати свої додатки до моделей з 00:30 до 8:30 ранку за пекінським часом. Про це повідомляє South China Morning Post.

DeepSeek прискорює розробку моделі R2. Вона зможе генерувати «більш якісний код»

Редактор

Китайський стартап DeepSeek прискорив розробку своєї нової моделі штучного інтелекту R2, яка має стати конкурентом GPT-5, яка, в свою чергу, теж поки не готова до релізу. Раніше компанія OpenAI звинуватила DeepSeek у тому, що R1 навчалася на її даних, повідомляє Reuters.

DeepSeek-R1 може генерувати шкідливий код — дослідники

Редактор

Китайська модель штучного інтелекту DeepSeek-R1 може використовуватись для створення шкідливого контенту, наприклад планів атаки з використанням біологічної зброї чи фішингових електронних листів зі шкідливим кодом. Про це повідомляє TechCrunch з посиланням на The Wall Street Journal.

DeepSeek обмежує доступ до свого API через перевантаження серверів

Редактор

Компанія DeepSeek, чия LLM-модель R1 сколихнула світові ринки минулого тижня, заявила, що вимушена обмежити доступ до свого API через нестачу серверних потужностей. За даними Bloomberg, DeepSeek призупинила поповнення кредитів API, щоб уникнути більш негативного впливу на свої послуги.

Цензура в DeepSeek працює навіть при локальному запуску моделі — дослідження

Редактор

Експерти видання Wired з’ясували, що цензура в китайській моделі штучного інтелекту DeepSeek вбудована в систему не тільки на рівні програми, але й на рівні навчання. Це означає, що при запуску моделі на локальному пристрої або в сторонній хмарі цензура не дозволить отримувати точні відповіді на теми, «делікатні» для китайської влади.

OpenAI представив «цифрового дослідника» Deep Research

Журналіст

OpenAI представила інструмент Deep Research, який за півгодини готує аналітичний звіт, на створення якого фахівець витратив би цілий робочий день. На тлі жорсткої конкуренції з китайським DeepSeek, компанія Сема Альтмана представила агента, здатного самостійно блукати інтернетом і формулювати висновки, повідомили в Terazus.

Microsoft відкрила доступ до DeepSeek-R1 у GitHub та Azure

Редактор

Microsoft перенесла велику мовну модель DeepSeek-R1 на платформи GitHub і Azure AI Foundry. Усі клієнти Microsoft тепер можуть інтегрувати її в свої програми, пише The Verge.

Реліз DeepSeek R1 — зміна правил гри у сфері LLM

Родіон Сальник BLOG

Co-founder of CASERS and Brocoders

20 січня 2025 року китайський стартап DeepSeek, що займається розробкою штучного інтелекту, випустив модель R1. Це нове доповнення до їхньої лінійки ШІ стало наслідком успіху DeepSeek-V3, моделі, яка швидко привернула увагу завдяки безпрецедентному поєднанню продуктивності та економічної ефективності. Зокрема, модель R1 представила недороге рішення, здатне конкурувати, а в деяких випадках і перевершувати моделі, розроблені найбільшими гравцями галузі. Її випуск сколихнув Кремнієву долину, і тепер технологічний світ намагається зрозуміти наслідки вражаючого злету DeepSeek.

OpenAI стверджує, що має докази «несанкціонованого використання» її моделі для навчання DeepSeek-R1

Редактор

Компанія OpenAI заявляє, що має докази того, що китайський стартап DeepSeek використовував її великі мовні моделі для навчання власної моделі DeepSeek-R1 з відкритим кодом. Представник Адміністрації президента США Девід Сакс вважає, що йдеться про ймовірну крадіжку інтелектуальної власності, пише Financial Times.

«Meta в режимі паніки»: Цукерберг створив 4 робочі групи для вивчення причин успіху DeepSeek

Редактор

Генеральний директор Meta Марк Цукерберг створив чотири «військові кімнати» з розробників, щоб дослідити причини успіху DeepSeek. За даними Windows Central, флагманська модель DeepSeek перевершує не тільки існуючі, але й наступну версію моделі Llama, реліз якої заплановано на початок 2025 року. Про це заявив директор інфраструктури штучного інтелекту Meta Метью Олдхем.

Розробники Hugging Face почали роботу над Open-R1 — «повністю відкритим» форком DeepSeek-R1

Редактор

Керівник відділу Hugging Face Леандро фон Верра та кілька розробників компанії запустили Open-R1 — проект, який має на меті створити удосконалений форк моделі DeepSeek-R1 з відкритими даними для всіх компонентів, включно з тими, які використовуються для навчання. Як повідомляє TechCrunch, дослідження, для роботи над яким виділено 768 графічних процесорів Nvidia H100, лише за три дні набрало на GitHub понад 11 000 зірок.

Витік чутливих даних та цензура. Експерт розповів про ризики використання DeepSeek

Журналіст

Занепокоєння з приводу китайських технологій штучного інтелекту, таких як DeepSeek, зростає серед країн, які прагнуть зберегти свою цифрову незалежність, повідомили в РБК-Україна.

DeepSeek скоротила розробку своєї моделі, скориставшись бібліотеками OpenAI

Редактор

Розробник Яншун Тай з компанії Meta помітив, що бібліотеки DeepSeek мають повну сумісність з бібліотеками OpenAI. Про це він розповів на LinkedIn, пояснивши, що таким чином китайська компанія суттєво скоротила процес розробки.

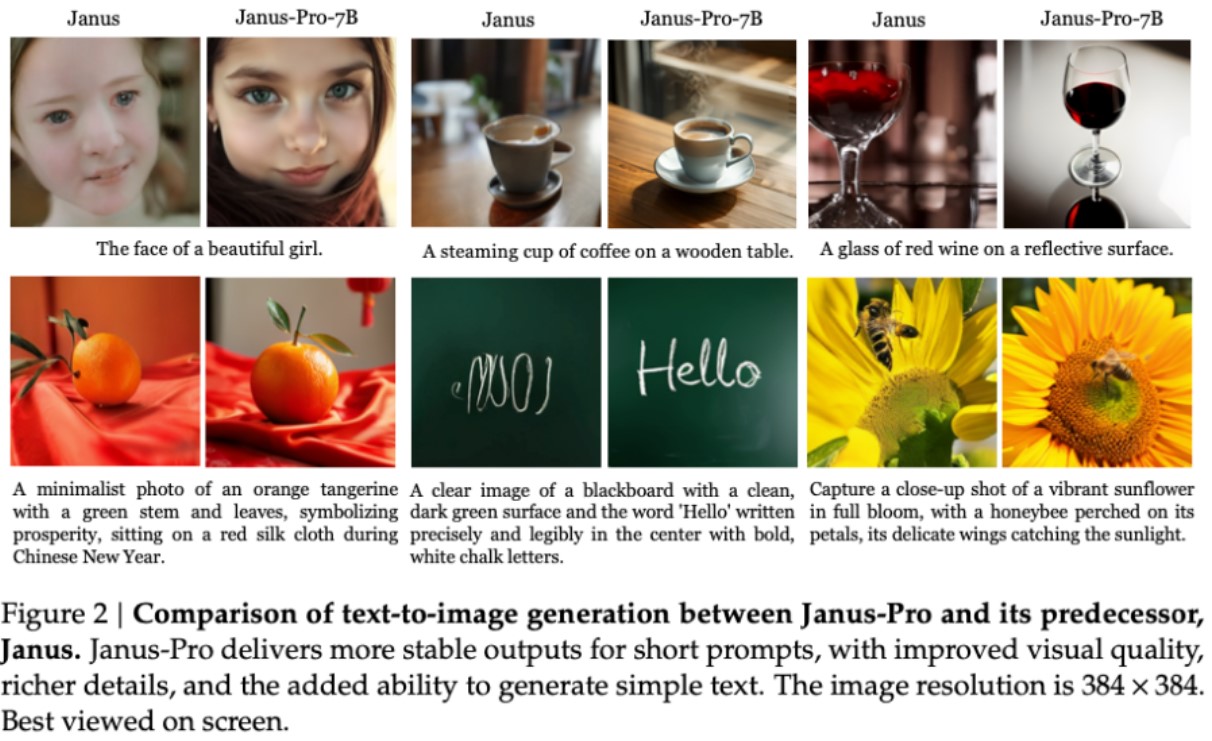

DeepSeek випускає Janus-Pro — генератор зображень, який конкурує з OpenAI DALL-E 3

Редактор

Компанія DeepSeek, яка днями викликала фурор своєю моделлю штучного інтелекту DeepSeek-R1, оголосила про реліз ще одного програмного продукту. Китайський стартап випустив сімейство мультимодальних моделей Janus-Pro. Як повідомляє TechCrunch, ці моделі здатні генерувати зображення краще, ніж OpenAI DALL-E 3, PixArt-alpha та Stable Diffusion XL.

Успіх DeepSeek-R1 ставить під загрозу багатомільярдну індустрію OpenAI

Редактор

Реліз нової китайської моделі DeepSeek-R1, яка не поступається за продуктивністю моделям сімейства GPT, але значно перевищує їх за економічною ефективністю, викликав побоювання щодо перспектив багатомільярдної індустрії OpenAI. Як повідомляє Cointelegraph, на навчання DeepSeek-R1, яка має відкритий код, було витрачено лише $6 мільйонів та задіяна незначна кількість графічних процесорів.

Китайська модель DeepSeek V3 з відкритим кодом перевершила усіх конкурентів

Редактор

Китайський стартап DeepSeek створив одну з найпотужніших на сьогоднішній день «відкритих» моделей штучного інтелекту — DeepSeek V3. Вона має відкритий код і навчена на наборі даних з 14,8 трильйонів токенів. 1 мільйон токенів дорівнює приблизно 750 000 слів, повідомляє Venture Beat.

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: