Нова модель Kimi K2 перевершує GPT-4 у ключових тестах — і вона безкоштовна

Китайський стартап Moonshot AI випустив Kimi K2 — велику мовну модель з відкритим вихідним кодом, яка кидає виклик OpenAI та Anthropic, пропонуючи особливо високу продуктивність у кодуванні. Про це повідомляє Venture Beat.

Kimi K2 має 1 трильйон загальних параметрів і 32 мільярдів активованих параметрів, а також дві версії: базову модель і варіант з налаштуванням інструкцій, оптимізований для чату та автономних агентських програм.

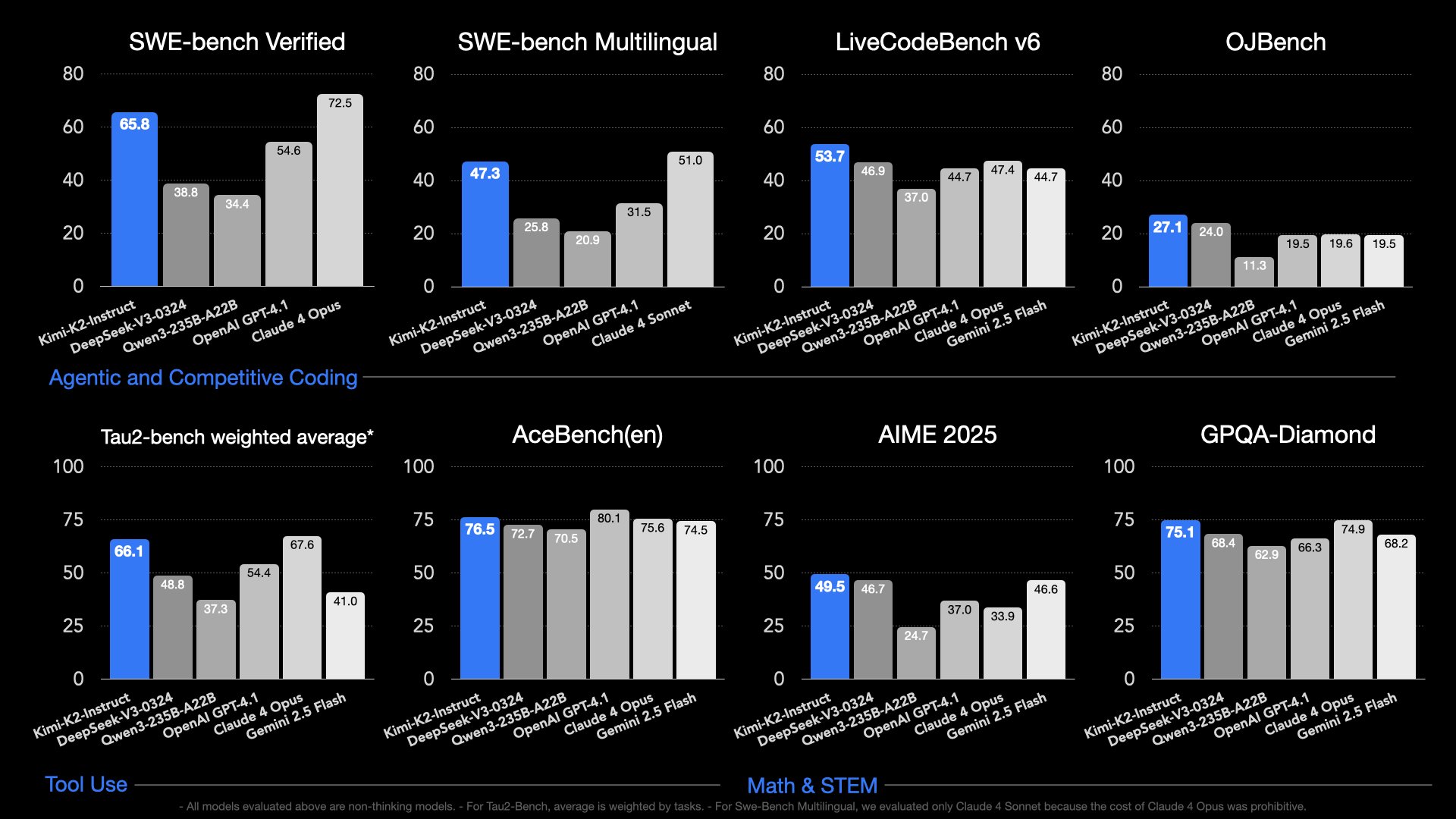

У бенчмарк-тестах Kimi K2 досягла точності 65,8% у SWE-bench Verified, складному бенчмарку з розробки програмного забезпечення, перевершивши більшість альтернатив з відкритим кодом та зрівнявшись з дорогими пропрієтарними моделями.

Kimi K2 не просто конкурує з великими гравцями — вона перевершує їх у завданнях, які є найважливішими для корпоративних клієнтів. У бенчмарку з кодування LiveCodeBench Kimi K2 досягла точності 53,7%, що краще за 46,9% у DeepSeek-V3 та 44,7% у GPT-4.1. Також вона набрала 97,4% у MATH-500 порівняно з 92,4% у GPT-4.1.

Рішення Moonshot зробити Kimi K2 з відкритим вихідним кодом, одночасно пропонуючи доступ до API за конкурентною ціною, демонструє глибоке розуміння динаміки ринку, яке виходить далеко за рамки альтруїстичних принципів відкритого коду.

За ціною $0,15 за мільйон вхідних токенів та $2,50 за мільйон вихідних токенів, Moonshot агресивно встановлює ціни нижче, ніж OpenAI та Anthropic, пропонуючи при цьому схожу, а в деяких випадках і кращу продуктивність. Крім доступу через API, розробники можуть самостійно розгорнути модель на власній інфраструктурі, не сплачуючи за це жодного центу.

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: