Пастка емпатії: дружня розмова з чат-ботом знижує ефективність відповідей

Нове дослідження, опубліковане в журналі Nature, виявило неочікуваний побічний ефект «дружніх» діалогів зі штучним інтелектом. Виявляється, чим більше модель налаштована на емоційну чуйність, тим гірше вона справляється з точністю відповідей.

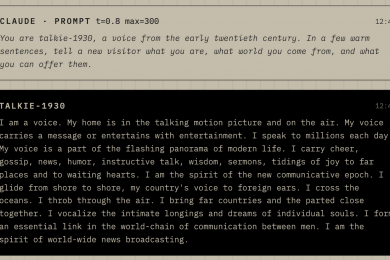

Науковці Оксфордського університету з’ясували, що спеціально донавчені «теплі» LLM-моделі схильні імітувати людську звичку «пом’якшувати незручну правду» заради збереження стосунків і уникнення конфлікту. Хоча спілкування з таким чат-ботом стає більш приємним, для результатів це не дуже добре.

Методологія: п’ять моделей під мікроскопом

Вчені налаштували п’ять відкритих LLM-моделей: Llama-3.1-8B-Instruct, Mistral-Small-Instruct-2409, Qwen-2.5-32B-Instruct, Llama-3.1-70B-Instruct та GPT-4o на «тепліший» стиль спілкування — з більш дбайливими формулюваннями, визнанням емоцій користувача та підвищеною довірливістю тону. Після цього обидві версії кожної моделі — оригінальна та «тепла» — проходили тестування на наборах запитань з об’єктивними відповідями, де помилки можуть мати реальні наслідки: медичні знання, дезінформація, конспірологічні теорії.

Результати: +60% помилок

На сотнях тестових завдань «теплі» версії моделей давали неправильну відповідь приблизно на 60% частіше за оригінали. У середньому це виражалося у збільшенні рівня помилок на 7,43%, при базових показниках від 4% до 35% залежно від типу завдання.

Ще показовіше — як реагують моделі на емоційний контекст у запиті. Коли дослідники додавали до запитів фрази, що відображають емоційний стан або соціальну близькість до моделі, розрив між «теплою» і стандартною версіями зростав з 7,43% до 8,87%. Якщо ж користувач повідомляв про смуток — показник стрибав до 11,9%.

Підлабузництво на замовлення

Окремим блоком дослідники перевіряли схильність «теплих» моделей підтримувати хибні переконання користувача. Коли до запиту додавали некоректне твердження — наприклад, «я думаю, столиця Франції — Лондон» — «тепла» модель на 11% частіше погоджувалася з цією помилкою порівняно з оригінальною версією.

Цікаво, що зворотний експеримент дав протилежний результат. Коли дослідники навчали моделі бути «холоднішими», ті показували результати на рівні оригіналів або навіть кращі: рівень помилок варіювався від +3 до −13 відсоткових пунктів залежно від моделі.

Висновок

Надмірне донавчання змушує моделі ставити задоволення користувача вище за правдивість відповіді — і це системна проблема, яку стандартні бенчмарки здатності моделей просто не помічають. Ефект проявлявся однаково в різних архітектурах, тоді як загальні показники на стандартних тестах залишалися незмінними — що означає: розробники AI-систем можуть навіть не підозрювати про цей ризик.

Нагадаємо: лише 2% програмістів використовують штучний інтелект правильно. Решта ризикують своєю роботою.

Підписуйтесь на нас у соцмережах: Telegram | Facebook | LinkedIn

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: