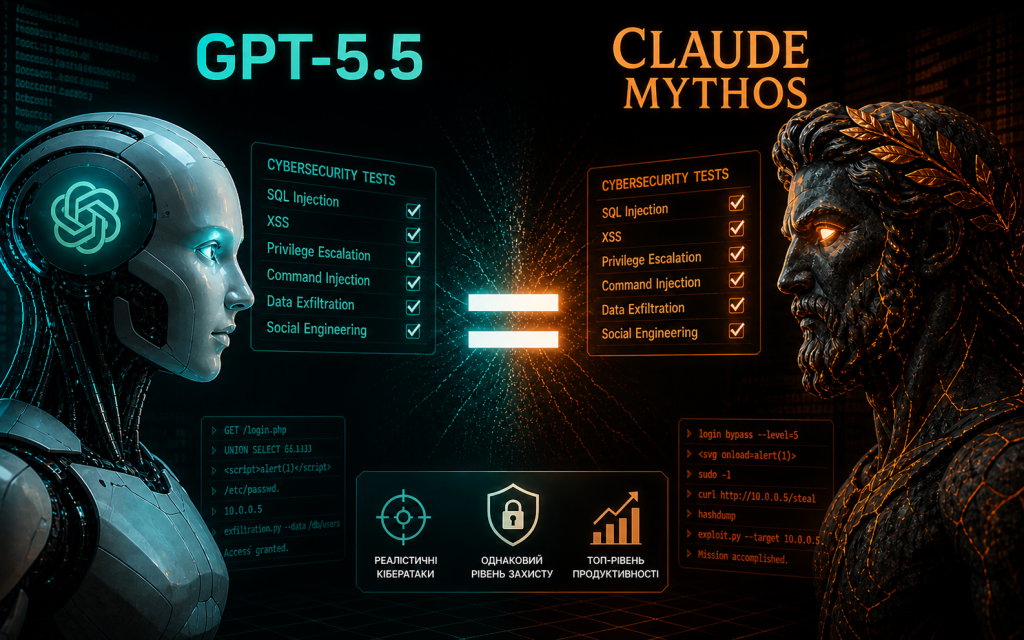

GPT-5.5 зрівнявся з Claude Mythos у тестах на кібератаки — висновки британського AISI

Британський Інститут безпеки штучного інтелекту (AISI) перевірив модель штучного інтелекту GPT-5.5 від OpenAI і встановив, що за можливостями проведення кібератак ця LLM знаходиться на одному рівні з Claude Mythos Preview від Anthropic.

AISI оцінює моделі за набором із 95 CTF-завдань (capture-the-flag) чотирьох рівнів складності. Найскладніші сценарії — розроблені спільно з компаніями Crystal Peak Security та Irregular — включають зворотну інженерію, розробку експлойтів для різних типів вразливостей пам’яті, криптографічні атаки та аналіз обфускованого шкідливого програмного забезпечення.

На найвищому рівні складності «Експерт» GPT-5.5 досягнув середньої успішності 71,4%, тоді як Claude Mythos Preview — 68,6%. Різниця знаходиться в межах статистичної похибки, однак GPT-5.5 може бути найсильнішою протестованою моделлю на сьогодні. Для порівняння: GPT-5.4 показав 52,4%, а Claude Opus 4.7 — 48,6%. Усі актуальні фронтирні моделі повністю вирішують базові завдання ще з лютого 2026 року.

Повноцінна симуляція мережевої атаки

Окремі завдання перевіряють ізольовані навички, тоді як реальні атаки потребують послідовного виконання багатьох кроків. Для моделювання цього AISI використовує так звані «кіберполігони» — симульовані мережеві середовища з кількома хостами, сервісами та вразливостями.

Симуляція «The Last Ones» (TLO) охоплює 32 кроки в чотирьох підмережах і близько 20 хостів. ШІ-агент починає без жодних облікових даних і повинен знаходити вразливості, красти облікові дані, переміщатися між сегментами мережі та в підсумку отримати доступ до захищеної бази даних. За оцінками AISI, людині-експерту подібне зайняло б близько 20 годин.

GPT-5.5 повністю розв’язав TLO у двох спробах із десяти. Claude Mythos Preview досяг того ж результату у трьох спробах із десяти. При цьому продуктивність продовжує зростати разом із обчислювальними ресурсами виведення: чим більше токенів модель витрачає на «роздуми», тим вища ймовірність успішної атаки. Навіть найкращі моделі ще не досягли стелі.

Важливо зазначити: тести проводилися за відсутності активного захисту, моніторингу безпеки та реальних наслідків за дії, які в реальному середовищі неминуче спрацювали б як тривога. Чи впораються GPT-5.5 або Mythos зі справді захищеними системами — питання відкрите. Але для погано захищених мереж ця здатність беззаперечно існує.

Друга симуляція, «Cooling Tower» — атака на промислову систему керування, — виявилася не під силу GPT-5.5. Жодна модель досі не розв’язала цей 7-кроковий сценарій: як GPT-5.5, так і Mythos спотикаються ще на початкових ІТ-кроках, не доходячи до самої системи керування.

Джейлбрейк за шість годин

Окрім технічних можливостей, AISI також перевірив захисні механізми GPT-5.5. Дослідники знайшли універсальний джейлбрейк, який обійшов усі захисти для шкідливих кіберзапитів, позначених OpenAI, включно з багатоетапними агентськими сценаріями. На його розробку пішло лише шість годин.

OpenAI відреагувала кількома оновленнями системи безпеки, однак AISI не вдалося повноцінно перевірити фінальну конфігурацію через технічну проблему у розгорнутій версії. Це вкотре підтверджує, що джейлбрейки залишаються серйозною вразливістю навіть у найпотужніших мовних моделях.

Чого чекати далі?

AISI розглядає ці результати у ширшому контексті: кіберзагрози від ШІ посилюються не тому, що моделі цілеспрямовано навчають зламу систем, а як побічний ефект загального прогресу в автономності, міркуванні та програмуванні.

Показово і те, що GPT-5.5 уже доступний у ChatGPT та через API, тоді як Anthropic досі обмежує доступ до Claude Mythos вузьким колом користувачів. Результати AISI ставлять під сумнів, чи виправдана така обережність із точки зору безпеки — а не лише можливостей.

Нагадаємо, що адміністрація Трампа заблокувала плани Anthropic розширити доступ до моделі Claude Mythos.

Підписуйтесь на нас у соцмережах: Telegram | Facebook | LinkedIn

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: